北京2022年4月21日/美通社/ -- 近日,浪潮信息副總裁、AI&HPC產品線總經理劉軍受邀出席新智元'元宇宙新人類'論壇,在《元宇宙服務器MetaEngine》主題報告中,分享了浪潮信息對元宇宙的認知,元宇宙面臨的技術挑戰,以及如何打造元宇宙新型基礎設施的見解。

以下基於演講實錄整理。

元宇宙是數實融合的數字載體

數實融合當前已經成為一種潮流的趨勢,當數字技術日益融入經濟社會發展各領域、全過程,持續推動著物理世界數字化、數字世界智慧化,逐漸形成了一場涵蓋個人生活方式、社會生產方式和國家治理方式的全面變革。

數實相融就是數字化世界同物理世界的融合,用數字世界來引導現實世界的運行,用數字世界的智慧化實現現實世界的智慧化。

元宇宙本質上是更高度的數實融合,它是數實融合的數字載體,這裡我們以數字孿生和虛擬人為例來談談。

數字孿生是元宇宙的數字空間基礎,它可以將物理對像以數字化的方式在虛擬空間進行動態呈現,它的應用體現在多個方面,比如孿生工廠,可以動態的呈現從生產製作的全過程動態管理,實現運轉效率的大幅提升;孿生城市可以在數字世界推演天氣環境、人口土地、產業交通等要素的交互運行,繪製城市畫像,幫助城市規劃、城市治理的效率提升;孿生基建可以讓我們在修建高速公路、樓體建築時,在數字世界對工程進行仿真模擬,評估結構和承力,在工程交付後的維護階段評估工程是否可以承擔特殊情況的壓力,以及監測可能出現的事故隱患。

數字虛擬人是元宇宙的重要實體(Entity)和生態,就像是元宇宙世界中的公民,是人類身份在虛擬世界的載體。利用數字虛擬人,人們也可以提升很多工作效率,比如虛擬主播可以7*24小時的進行新聞播報,可以讓人們全天候的了解天下大事,虛擬醫生可以通過打通就診數據、跟踪上萬種細微指標特徵差異,打破時間和空間,實現醫生就診病人從1對1轉變為1對多管理,虛擬模特在疫情下緩解了模特緊缺的市場情況,解決模特的供不應求。

元宇宙:認知世界再現世界

元宇宙,可以說是一個認知世界、再現世界的過程,這個過程涉及到在線協同建模、高精度仿真、實時渲染、智能交互等多個環節,每個環節下都有對應的關鍵技術、軟件棧和算法工具。

首先,構建元宇宙需要進行3D建模,最近比較前沿的還有AIGC(利用GAN/多模態模型生成內容創作),這部分的工作需要多人在線協同構建。

由多人在線協同生成3D模型生成後,需要在元宇宙中仿真運行,通過結構仿真、感知仿真和控制仿真可以對模型進行驗證,如果說建模是對物理實體理解的模型化,那麼仿真就是驗證和確認這種理解的正確性和有效性的工具。

通過光線追踪、光柵化、數據流傳輸可以讓虛擬人、數字世界更加逼真,為用戶帶來超現實的感官體驗,呈現出一個更加豐富多彩的數字世界,擁有逼近現實世界一樣的沉浸感。

利用CV/NLP/ASR/TTS等AI技術,讓數字世界的虛擬人可以能聽、會說、能交互,從而打破數字世界和物理世界的邊界,實現線上線下的交融。

元宇宙通過以上多個環節、多個工具才能達到超越感官、智能交互的水平,像現實世界一樣豐富多彩。

元宇宙需要強大的算力基礎設施

元宇宙的出現和發展帶來的不僅有精彩,還有挑戰,元宇宙構建的各個環節都需要用到不同類型的算力支撐,也就是元宇宙的算力基礎設施。

大規模、高複雜的數字孿生空間、數字人和其他實體角色的建模需要眾多設計師協同創作完成,現實世界和數字世界的交互則需要實時、高清的3D渲染算力和低延遲的網絡數據傳輸,增加了雲端協同的處理需求。

元宇宙的應用會涉及到動力、熱力、流體等多類物理仿真,這需要用到高精度的數值計算,來支撐物理仿真和科學可視化。

讓數字世界無限接近現實世界,需要高逼真、沉浸感的3D場景構建和渲染。舉個iMax 3D電影的例子,比如《戰鬥天使阿麗塔》這部電影,其中阿麗塔高度擬真的視覺特效令人震撼,這樣以假亂真的渲染效果來源於巨大的算力消耗:主角13萬根髮絲每根都需要進行單獨渲染,僅1幀畫面渲染就要耗費100個小時,而元宇宙的渲染不僅只涉及一個虛擬人,還包括建築、城市等其他元素,這需要巨量的圖形圖像計算支撐。

同時,元宇宙還會涉及到人機交互等AI應用場景,由AI驅動的數字人往往需要結合語音識別、NLP、DLRM等AI算法從而實現交互能力,這些模型的背後需要強大的AI算力來支撐其訓練和推理需求。

可以看到,要構建高度擬真的數字世界並實現數億用戶實時交互的'元宇宙',當前面臨著場景規模大、場景複雜度高,以及多設計師和多部門協作、極高逼真數字元素製作,實時渲染、仿真和交互等諸多挑戰,並對支撐元宇宙構建和運轉的核心源動力-- 算力提出更高的要求。這種要求不僅僅是高性能、低延遲、易擴展的硬件平台,還有端到端、生態豐富、高易用的軟件棧。

浪潮元宇宙服務器MetaEngine

浪潮元宇宙服務器MetaEngine正是為滿足這些苛刻要求而設計的軟硬一體化基礎設施。

作為元宇宙生態的底層算力支撐平台,MetaEngine將承載元宇宙構建和運行所需的技術和工具,提供對AI、渲染、仿真、建模等負載的算力支持,滿足元宇宙創建所需的'協同創建、實時渲染、高精仿真、智能交互'4大作業環節的不同類型算力需求,並通過高速、無阻塞的網絡信道,按需擴展至大規模算力集群。浪潮元宇宙服務器結合業界最強軟硬件生態,協同優化加速數字孿生世界構建,為用戶打造高效的元宇宙協同開發體驗。單台元宇宙服務器即可支持256位元宇宙架構師協同創作,每秒AIGC 2000個數字場景,1000位VR/AR用戶共享10K超高清3D數字世界順暢體驗。

元宇宙服務器產品方案架構

在硬件上,MetaEngine採用浪潮領先的異構加速服務器的旗艦系統,支持最先進的CPU和GPU,具有強大的RDMA通信和數據存儲能力,支持強大的渲染和AI計算能力。

在軟件上,可以支持對應每個作業環節的各類專業軟件工具,用戶可以根據使用習慣靈活選擇,同時系統集成了NVIDIA Omniverse Enterprise,為用戶準備了豐富的開發套件,包括專門用於結構、感知、控制仿真的Simulation SDKs,用於渲染、實時光追、AI降噪的SDKs,用戶可以通過Kit功能將這些不同的SDK進行模塊化的組合,快速完成定制化App或者微服務的開發,當然這裡已經為用戶準備好了一些廣泛適用的App比如用於建模和渲染的Create,用於可視化的View,更為重要的是,用戶通過App開發的內容可以通過數據庫和協作引擎NUCLEUS,建模工具互聯插件CONNECT與第三方專業軟件工具無縫連接,目前CONNECT已經提供了20多種Plugins,支持與3DS MAX、UE、MAYA等軟件互聯。

MetaEngine的目標是構建一個端到端、生態豐富和高易用的協作平台,為用戶打造一站式元宇宙開發體驗。

MetaEngine全面支持Omniverse

當前,MetaEngine已經全面支持英偉達的Omniverse Enterprise,將高性能GPU 的圖形計算、AI計算與高速存儲訪問、低延遲網絡和精確計時相結合,是一個數據中心級的軟硬一體解決方案,專用於為大規模數字孿生提供算力和應用支持,以實時創建和運行非常複雜的模型和逼真的仿真環境。

目前的MetaEngine元宇宙服務器集成A40的專業GPU,CX6 Dx高速網卡,並與企業級管理和編排軟件相結合,為用戶準備了豐富的建模、渲染、仿真套件。同時,可以將32台MetaEngine組合成為1個集群式的可擴展單元,多個可擴展單元可以繼續橫向擴展組成更大規模集群,可提供非凡的計算性能和超高的網絡帶寬,滿足工廠、城市乃至更大規模複雜仿真和實時數字孿生的需求。

在這裡,我也將為大家分享如何用浪潮MetaEnigne創建數字孿生和虛擬人。

MetaEngine創建數字孿生

首先,以新品設計、流水線調度生產、上市為例,談一談MetaEngine如何創建運行數字孿生,來優化工作流,提高生產效率。當生產及需求達到一定規模時,生產、配送、分揀的過程就成為了一個系統工程性問題,如飲料、汽車等各行業的大規模製造公司。使用數字孿生讓虛擬世界的高精仿真代替現實世界的運行,在產品設計生產、調配之前,模擬其過程取得物理裝置最優的參數配置,提高效率贏得市場。

如何建造一個流水線上的數字孿生? MetaEngine提供元宇宙構建所需的多元算力和Omniverse組件,為構建和運行該數字孿生提供基礎能力。

首先是在線建模,按照1:1數字模型創建工廠的建築、流水線等生產交付全過程。 Connect組件提供20多個第三方建模軟件的連接插件,允許用戶使用第三方建模工具接入協同建模,Omniverse使用統一數據格式USD與第三方建模軟件(SketchUp/Revit)進行數據交互, Nucleus數據庫提供多人數據管理功能,允許多用戶同時修改可視化、渲染3D-USD文件。

高精仿真階段使用Simulation組件仿真新產品的材質及物理屬性,根據高逼真的虛擬物品,使用Replicator完成仿真環境的部署、搭建。 Omniverse豐富的材質庫可以為設計模擬物品,提供更好的逼真度,配合使用物理仿真、動畫製作的軟件(Ansys/Houdini)可以完成整個流水線和物品的高精仿真;Replicator組件則根據仿真結果生成AI模型訓練需要的合成數據環境。

實時渲染階段,使用Renderer組件對仿真環境中的材質、光照條件實時渲染畫面,生成用於訓練AI模型的合成數據。根據合成數據在MetaEngine中訓練我們的AI視覺模型,提供物理實體及流水線流程的監控及理解。

智能交互階段,將在MetaEngine中訓練完成的AI模型部署於物理環境與虛擬環境,虛擬環境中的AI推理指導物理實體行為,物理環境中實際反應再返回虛擬環境指導模型融合訓練。虛擬世界中如檢測到畫面中的擁堵或者空閒,可以反饋到物理流水線改變作業狀態,反之物理流水線上真實的結果可以生成真實數據繼續更新AI模型。

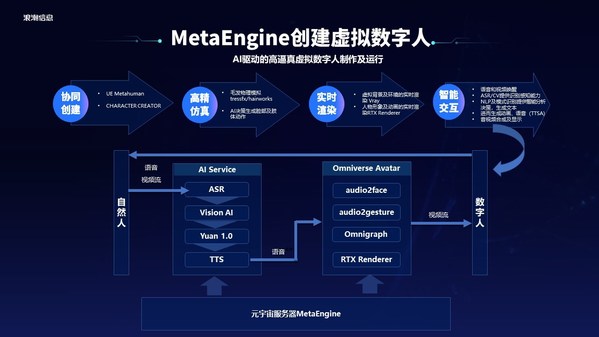

MetaEngine創建虛擬數字人

我們再以高逼真的交互型虛擬數字人的製作及使用為例,依然按照'協作建模---高精仿真---實時渲染---智能交互'的作業流程來看如何用MetaEngine創建虛擬人。

首先可以使用UE Metahuman/CHARACTER CREATOR配合Omniverse Nucleus/Connect進行3D人物形象及人臉建模。然後通過高精仿真,讓虛擬數字人更加自然、真切的與我們交流,比如對毛髮的模擬,12萬根毛髮如何在風中飛舞,這得需要強大的算力支撐,還需要藉助AI模型生成逼真的手勢和麵部表情。

再就是實時渲染,MetaEngine中的Omniverse RTX Renderer可以提供實時渲染能力,讓人物動畫及其場景實時立體地展示在我們面前,通過屏幕或XR設備進行溝通交流。

最後是智能交互使用,這塊需要有大量的AI模型提供支撐,把整個智能交互的流程放大來看。用戶首先通過語音和視頻分別通過ASR 和Vision AI模型進行推理,得到文本及視頻動作理解;將文本、動作理解融合送入的NLP語言模型如源1.0生成語言文本,再將語言文本轉化為語音或動作語言表述,通過TTS模型將文本轉化為語音,語音驅動Avatar製作的虛擬數字人,產生面部行為(audio2face應用)動作手勢(audio2gesture),並通過RTX Renderer實時渲染能力生成動畫視頻作為輸出與用戶交互。

當然,元宇宙不僅只有數字孿生和虛擬人。元宇宙要實時地映射現實世界,在元宇宙中再現工業、農業、服務業、社會、經濟、文化、城市、鄉村、地球等現實世界,用戶'身臨其境'地在其中社交、娛樂、會議、協作、旅遊、購物、教育,所有人都可以在其中互動,要達到這樣的目標,還有很長的路要去走,需要不斷探索和發現更有效率的實現元宇宙的創新技術和方案。

如同發展汽車產業需要高速公路一樣,汽車是應用,公路是基礎設施,元宇宙也需要基礎設施。 MetaEngine元宇宙服務器即是浪潮為加速元宇宙產業提出的算力基礎設施。